DMflow.chat

廣告

DMflow.chat:智慧整合,創新溝通!除了持久記憶與客製欄位外,更支持真人與 AI 的靈活轉換,無縫連接資料庫與表單,讓網頁互動更靈活高效。

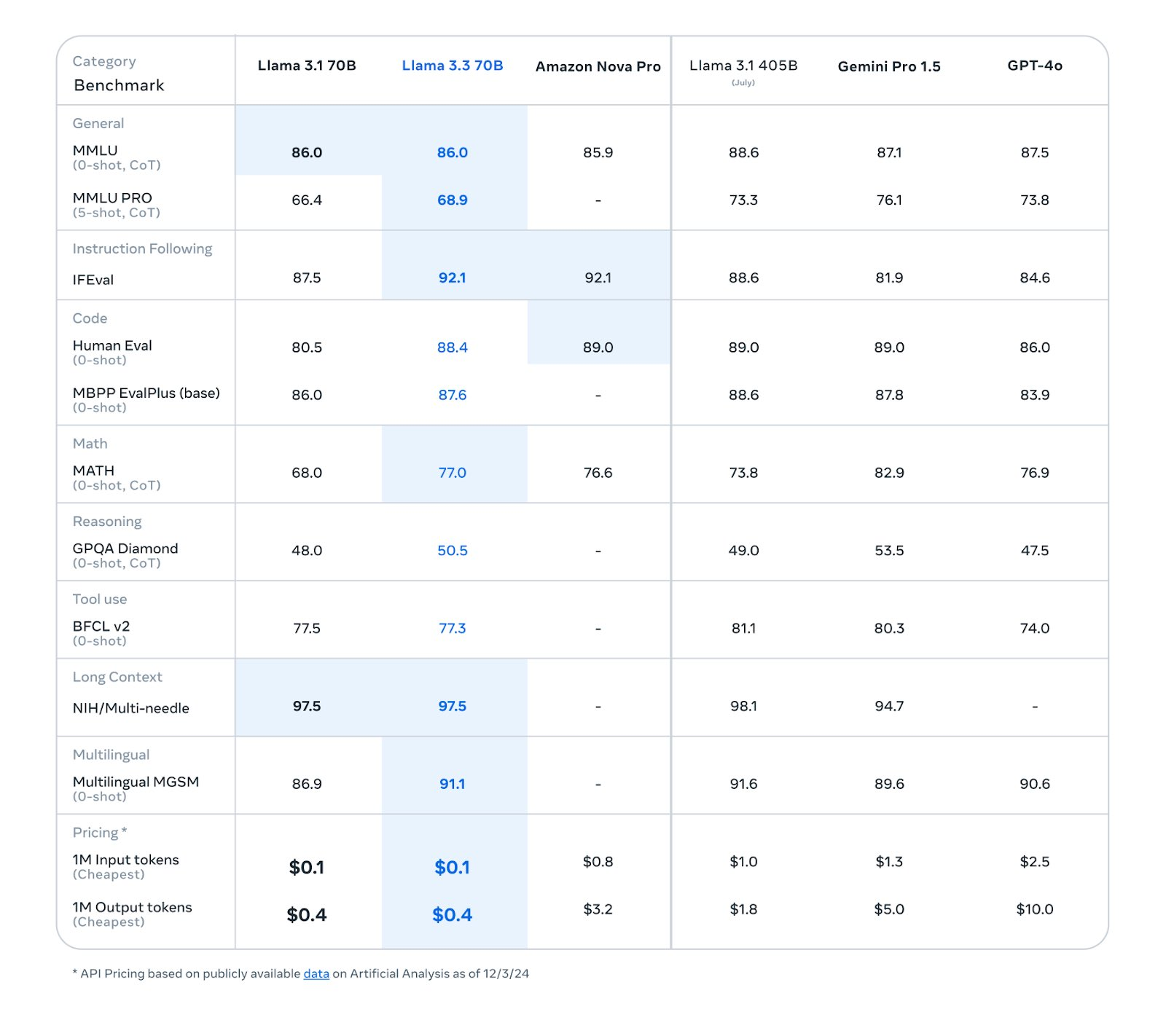

Meta 最新推出的 Llama 3.3 70B 模型,不僅以創新技術挑戰傳統規模極限,還以不足 Llama 3.1 405B 模型五分之一的參數量,實現幾乎相同的表現品質。這對於開發者而言,不僅是性能上的突破,更是成本效益的顯著提升。本文將深入探討這款模型的特性、應用場景,以及其對開發者的影響。

圖片來自https://ollama.com/library/llama3.3

Llama 3.3 70B 的技術突破

Llama 3.3 通過新的調教後技術,在進行日常讀解、數學和一般知識等任務時展示出前所未有的性能。與其他模型不同,Meta 深入挑戰“規模休止”說明,利用更優化的模型建構,以超過參數增長的方式实現性能較大的跳躍。

這些改進不僅僅讓 Llama 3.3 70B 挑戰大型模型的地位,還重塑了 AI 發展的規模觀念。

Llama 3.3 70B 在以下多個領域有了顯著進步:

這些進步對於需要高效、高準確率的工具的開發者尤為關鍵。

這些功能確保 Llama 3.3 能滿足多樣化的商業與研究需求,特別是在多語言對話與自然語言生成領域。

若對 Llama 家族的快速發展感到不適應,這是其關鍵演變的簡述:

Llama 3.3 的核心定位在於支持多語言的助理型對話應用和自然語言生成任務。例如:

雖然 Llama 3.3 目前支持 8 種語言,但開發者仍可依照需求進行特定語言的微調,只需遵循社群授權與責任使用政策。

Llama 3.3 70B 不僅僅是一個技術上的突破,也代表了人工智慧進入“質量平衡”的新時代,爲開發者和企業部署帶來突破性的機會!

DMflow.chat:智慧整合,創新溝通!除了持久記憶與客製欄位外,更支持真人與 AI 的靈活轉換,無縫連接資料庫與表單,讓網頁互動更靈活高效。

MMaDA 橫空出世:顛覆你想像的多模態擴散語言模型!AI 的下一波浪潮來了? 你聽說過 MMaDA 嗎?這可不是什麼新的咖啡口味,而是一個可能改變我們與 AI 互動方式的全新多模態擴散...

撼動 AI 界的開源新星:BAGEL 多模態模型,功能直逼 GPT-4o、Gemini 2.0! 來自ByteDance的開源統一多模態模型 BAGEL 正式登場!它不僅擁有與 GPT-...

微軟 BitNet b1.58 震撼登場:跑更快、更省電的 1 位元 AI 模型來了? AI 發展快到讓人眼花撩亂,但模型的「食量」也越來越驚人?來看看微軟最新的 BitNet b1.5...

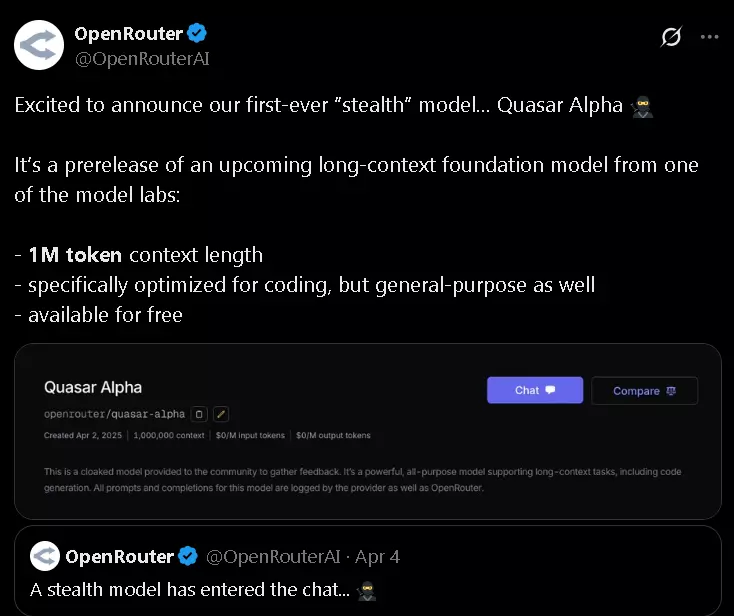

秘密武器登場?OpenRouter 無預警釋出百萬級長上下文模型 Quasar Alpha! AI 界又有新玩具了!OpenRouter 悄悄推出了一款名為 Quasar Alpha 的...

Mistral Small 3:開創效能與開放性兼具的 AI 模型 Mistral AI 於 2025 年 1 月推出全新的 Mistral Small 3 模型,這款採用 Apache...

DeepSeek V3:突破性的開源大型語言模型,超越 GPT-4 與 Claude 3 2024年底,中國 DeepSeek 發布了突破性的開源語言模型 DeepSeek V3。這款模型在多...

DeepSeek V3 引發爭議:中國 AI 模型為何自稱是 ChatGPT? 中國 AI 實驗室 DeepSeek 新發布的模型出現認知混亂,自稱 ChatGPT。本文將深入探討此現象...

Canva 挑戰 Adobe 市場地位:收購 Affinity 打造完整設計工具 Canva 在今(2024)年3月26日宣布,以數億英鎊收購 Affinity 引發了設計界的討論。本文深入探...

OpenAI Day5: 蘋果裝置用戶的福音:ChatGPT 無縫整合 iOS、iPadOS 與 macOS,使用更便利! 描述: 蘋果裝置用戶有福了!OpenAI 與蘋果攜手合作,將 Cha...

By continuing to use this website, you agree to the use of cookies according to our privacy policy.