DMflow.chat

廣告

一站整合多平台聊天,體驗真人與 AI 自由切換的新境界!支援 Facebook、Instagram、Telegram、LINE 及網站,結合歷史記錄、推播通知、行銷活動及客服轉接,全面提升效率與互動。

Google在 I/O 2025 大會上丟出震撼彈——Gemma 3n 正式登場!這款專為手機、平板等低資源裝置打造的多模態 AI 模型,號稱僅需 2GB RAM 就能讓你的裝置聰明起來,處理文字、影像、影片甚至音訊都毫不費力,而且還能離線運作。這究竟是科技魔法還是未來趨勢?讓我們一起深入挖掘 Gemma 3n 的技術亮點,看看它會如何顛覆我們的行動 AI 體驗,以及對整個 AI 生態又將帶來哪些影響。

最近科技圈最火熱的話題,莫過於 Google 在 I/O 2025 大會上揭曉的 Gemma 3n 模型了。想像一下,你的手機、平板,甚至是那些規格比較入門的筆記型電腦,未來可能都將搭載一顆「超級大腦」,能夠即時理解你說的話、看的圖片、播放的影片,甚至是你周遭的聲音——而且這一切,都可以在不需要網路連線的情況下完成。聽起來是不是有點科幻?但 Gemma 3n 的出現,似乎正讓這一切加速成為現實。

這可不是空穴來風。Gemma 3n 繼承了自家兄弟 Gemini Nano 的優秀基因,更青出於藍,加入了音訊理解這項新技能。這意味著,未來的行動裝置 AI,將不再只是單純的文字或影像處理,而是真正意義上的「多模態」互動。你說,這能不讓人興奮嗎?

那麼,Gemma 3n 究竟有何過人之處,敢號稱要在低資源設備上掀起一場多模態革命呢?

簡單來說,Gemma 3n 是 Google Gemma 系列的最新力作,它的核心設計理念就是「為邊緣運算和行動裝置而生」。你知道嗎?這代表它不需要依賴強大的雲端伺服器,直接在你手中的裝置上就能運作。

根據官方說法,Gemma 3n 基於 Gemini Nano 架構,並透過一種叫做「逐層嵌入」(Per-Layer Embeddings, PLE)的創新技術,成功將模型的記憶體佔用壓縮到驚人的程度。這讓它即便擁有 50 億(5B)和 80 億(8B)的原始參數規模,實際運行時的記憶體開銷卻只相當於 20 億(2B)和 40 億(4B)參數的模型。白話一點說,就是它只需要 2GB 到 3GB 的動態記憶體空間 就能順暢運作!這對於那些記憶體本來就不大的入門級智慧型手機或輕薄筆電來說,簡直是天大的好消息。

讓咱們來看看它的核心本領有哪些:

根據一些初步的測試數據,Gemma 3n 在處理 1080p 的影片畫面或是長約 10 秒的音訊片段時,能準確描述內容的成功率高達 90%。這無疑為行動裝置 AI 應用立下了一個新的標竿。

Gemma 3n 之所以能夠在小小的手機上發揮如此強大的多模態能力,背後的技術功不可沒。它不僅繼承了 Gemini Nano 的輕量化架構,還融入了多項 Google DeepMind 的創新。

開發者朋友們,好消息是 Gemma 3n 的預覽版已經可以在 Hugging Face 上找到了 (例如 gemma-3n-E2B-it-litert-preview 和 E4B),大家可以透過 Ollama 或 transformers 函式庫來搶先體驗。在 LMSYS Chatbot Arena 的評分中,Gemma 3n 的 Elo 分數達到了 1338,在多模態任務上的表現超越了 Llama 4 的 3B 模型,足見其在行動端 AI 領域的領先潛力。

聽起來很技術,但這跟我們有什麼關係呢?關係可大了!Gemma 3n 的低資源需求和強大的多模態能力,讓它在許多生活場景中都能大放異彩:

可以預見,Gemma 3n 的裝置端運作能力將會大大推動邊緣 AI 的普及。尤其是在教育、無障礙溝通和行動內容創作這些領域,它的潛力真的是無可限量。

Gemma 3n 的發布,自然在社群媒體和 Hugging Face 這類的開發者社群中掀起了熱烈討論。許多開發者都對它讚不絕口,稱其為「行動端 AI 的遊戲規則改變者」。特別是它僅需 2GB RAM 就能運行的低門檻,以及強大的手語理解功能,更是讓大家驚艷不已。Hugging Face 上的預覽版模型,在發布第一天就吸引了超過十萬次的下載,可見其社群魅力有多強大。

不過,事情總有兩面刃。也有一部分的開發者對於 Gemma 系列模型非標準的開源許可證表示了一些擔憂。他們認為,目前許可證中對於商業用途的某些限制,可能會影響到企業級的部署和應用。對此,Google 方面也回應說,未來將會持續優化授權條款,以確保更廣泛的商業相容性。所以,如果你是開發者,並且打算將 Gemma 3n 用於商業專案,建議還是要仔細看一下許可證的詳細內容。

那麼,Gemma 3n 在眾多 AI 模型中,到底處於什麼樣的地位呢?

分析來看,Gemma 3n 的發布進一步鞏固了 Google 在開放模型領域的領先地位。與 Meta 的 Llama 4(通常需要 4GB 以上的 RAM)或是 Mistral 的一些輕量化模型相比,Gemma 3n 在低資源設備上的多模態性能確實更勝一籌,尤其在音訊處理和手語理解這兩個獨特功能上,更是目前市場上的佼佼者。

值得注意的是,Gemma 3n 的出現,也為像是 Qwen3-VL 這類中國本土的優秀模型提供了與全球 AI 生態接軌、甚至未來潛在相容合作的機會。

當然,我們也要客觀一點。目前釋出的 Gemma 3n 仍然是預覽版本,可能還不是那麼的完美穩定。在處理一些特別複雜的多模態任務時,或許還需要等待預計在 2025 年第三季推出的正式版本。對於想嚐鮮的開發者來說,可以多關注 Google AI Edge 的更新日誌,以便獲取最新的優化資訊。

總結來說,Google Gemma 3n 的發布,絕對是行動 AI 領域一個重要的里程碑。它僅需 2GB RAM 的超低資源需求、強大的多模態處理能力,以及完全在裝置端運作的特性,都標誌著 AI 技術正從遙遠的雲端,加速走向我們日常使用的邊緣設備。

特別是 Gemma 3n 在手語理解和音訊處理方面的突破,不僅為無障礙技術開闢了全新的可能性,也為全球的 AI 開發者,包括我們華語地區的開發者,提供了一個與世界頂尖技術同步、共同參與建構未來 AI 生態的絕佳機會。

Gemma 3n 的出現,不只是一個新模型的發布,它更像是一個訊號,預示著一個更加智慧、更加便捷、更加個人化的行動 AI 時代,即將到來。我們都拭目以待,看看它未來還會帶來哪些驚喜!

Q1: Gemma 3n 真的只需要 2GB RAM 就能跑嗎? A1: 是的,根據 Google 的說法,Gemma 3n 5B 參數模型透過逐層嵌入 (PLE) 等技術,其實際運行的動態記憶體足跡大約是 2GB。這使得它非常適合在記憶體有限的行動裝置上運行。

Q2: Gemma 3n 支援哪些類型的輸入和輸出? A2: Gemma 3n 支援多模態輸入,包括文字、影像、短片和音訊。它可以理解這些不同類型的輸入,並主要產生結構化的文字輸出。

Q3: 開發者現在可以怎麼試用 Gemma 3n?

A3: 開發者可以透過以下幾種方式初步體驗 Gemma 3n:

* Google AI Studio: 直接在瀏覽器中試用,無需額外設定,可立即探索其文字輸入功能。

* Google AI Edge: 提供了工具和函式庫,供開發者將 Gemma 3n 整合到本地裝置,目前支援文字和影像的理解/生成。

* Hugging Face: 可以下載預覽版模型 (gemma-3n-E2B-it-litert-preview 和 E4B),並透過 Ollama 或 transformers 函式庫進行測試。

Q4: Gemma 3n 的開源授權有什麼需要注意的嗎? A4: Gemma 系列模型的開源許可證並非完全標準的 Apache 2.0 等,對於商業用途可能存在一些限制。Google 表示未來會優化授權條款。建議開發者在用於商業專案前,仔細閱讀並理解相關的許可證細節。

Q5: Gemma 3n 和 Gemini Nano 有什麼關係? A5: Gemma 3n 和下一代的 Gemini Nano 共享相同的新一代先進架構。Gemma 3n 作為開放模型,讓開發者可以搶先體驗和實驗這套架構。這套架構未來也會應用於 Google App 和裝置生態系中的 Gemini Nano 功能。

Q6: Gemma 3n 的音訊處理能力具體有哪些? A6: Gemma 3n 新增的音訊處理能力非常亮眼,包括: * 高品質的自動語音辨識 (ASR),也就是語音轉文字。 * 語音翻譯,將語音直接翻譯成目標語言的文字。 * 理解跨模態的交錯輸入,例如結合語音和影像來理解複雜互動。 * 手語理解也是其音訊(更廣義上是視覺溝通)處理的一大突破。

資料來源:

一站整合多平台聊天,體驗真人與 AI 自由切換的新境界!支援 Facebook、Instagram、Telegram、LINE 及網站,結合歷史記錄、推播通知、行銷活動及客服轉接,全面提升效率與互動。

Google Veo 3 影片模型大解禁!Gemini App 全球擴展,但「以假亂真」的隱憂也浮現? Google 最新 AI 影片生成工具 Veo 3 迅速在全球擴展,用戶驚嘆其「神...

Google DeepMind Lyria2 震撼登場:AI 即時譜寫你的音樂狂想曲,高傳真音質顛覆創作想像! Google DeepMind 最新 AI 音樂生成模型 Lyria2 正...

Google Beam橫空出世:2D視訊一秒變3D!跟「尷尬」眼神說掰掰,即時翻譯讓你聊遍全球! 想像一下,開會不用再盯著冷冰冰的螢幕,而是像跟真人面對面一樣自然交流?Google最新發...

Claude AI 網頁搜尋功能「突襲」免費開放!你的 AI 助理即時戰力大升級 Anthropic 旗下 AI 助理 Claude 再次震撼市場!原本僅限付費用戶的網頁搜尋功能,現在全...

Claude 4 橫空出世:Anthropic 最新 AI 模型帶來什麼驚喜?編碼、推理能力再創高峰! Anthropic 正式發表新一代 Claude 模型:Claude Opus 4...

AI界風雲變色!Anthropic 為何拒絕 Windsurf 使用 Claude 4?商戰大戲上演中! Anthropic 最新 AI 模型 Claude Sonnet 4 與 Opu...

Google Beam橫空出世:2D視訊一秒變3D!跟「尷尬」眼神說掰掰,即時翻譯讓你聊遍全球! 想像一下,開會不用再盯著冷冰冰的螢幕,而是像跟真人面對面一樣自然交流?Google最新發...

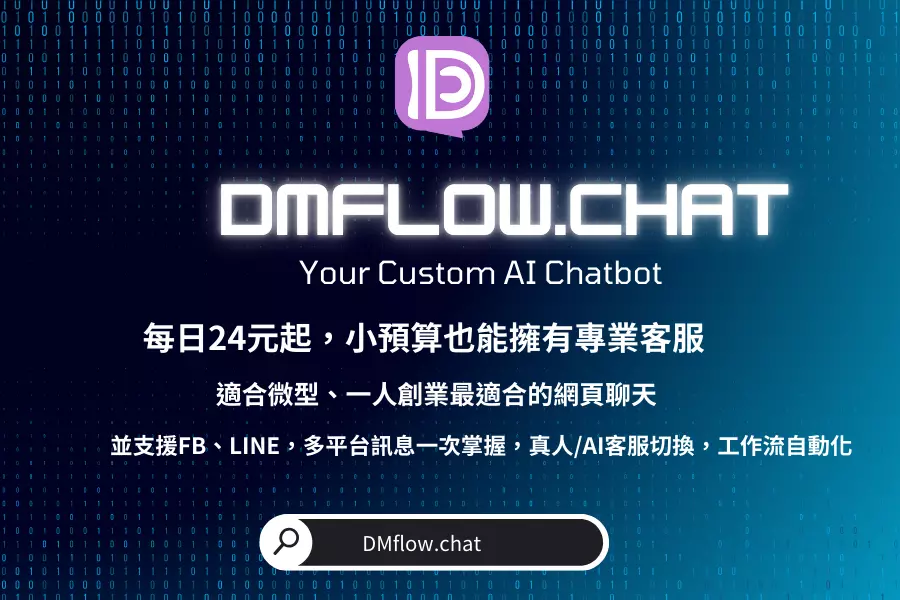

Fish Speech 1.5 震撼登場:不只多聲道,還想跟你即時聊天!語音合成新紀元來了 還在用生硬的機器語音嗎?快來看看 Fish Audio 推出的全新語音合成模型 Fish Sp...

初探 Amazon Nova LLM 系列:價格與功能全面剖析 描述 Amazon 在 AWS re:Invent 大會上推出了全新的大型語言模型系列 Amazon Nova,包含 Micro...

By continuing to use this website, you agree to the use of cookies according to our privacy policy.