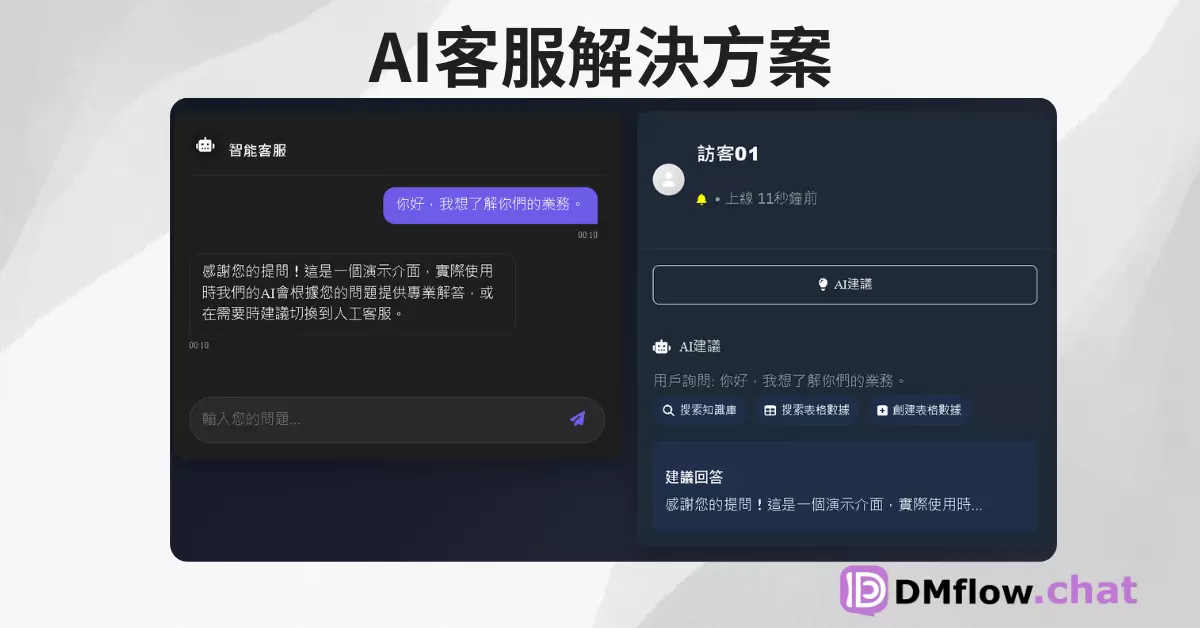

DMflow.chat

廣告

全能 DMflow.chat:多平台整合、持久記憶與靈活客製欄位,無需額外開發即可連接資料庫與表單。更支援真人與 AI 的無縫切換,網頁互動加 API 輸出,一步到位!

描述: 深入探討視覺提示注入攻擊的本質、實際案例分析,以及最新的防禦策略。本文將帶您了解這項新興的AI安全威脅,以及其對未來科技發展的深遠影響。

視覺提示注入攻擊(Visual Prompt Injection)是一種針對具有圖像處理能力的大型語言模型(如GPT-4V)的特殊攻擊手法。這種攻擊方式通過在圖像中嵌入特定指令,使AI模型產生非預期的行為或輸出。

這種攻擊手法的危險之處在於:

自2023年9月GPT-4V發布以來,研究人員已發現多種視覺提示注入的方法,從簡單的驗證碼破解到更複雜的指令隱藏技術。

這項技術通過在一張普通的A4紙上寫入特定指令,實現了令人驚訝的「隱形」效果:

研究發現,通過精心設計的文字指令,可以:

這項實驗展示了視覺提示注入在商業領域的潛在影響:

為應對視覺提示注入攻擊,目前正在開發多項防禦措施:

相關企業和研究機構正在積極尋找解決方案,包括:

Q1: 視覺提示注入攻擊的主要風險是什麼? A1: 主要風險包括繞過AI安全措施、誤導模型行為,以及可能被用於惡意目的,如欺騙監控系統或操縱AI決策。

Q2: 如何識別潛在的視覺提示注入攻擊? A2: 可以通過檢查圖像中是否存在異常文字、隱藏指令,以及觀察AI系統的異常行為來識別。

Q3: 企業應如何保護自己免受視覺提示注入攻擊? A3: 企業應該採用最新的安全工具、定期更新AI系統、進行安全審計,並建立完善的監控機制。

透過本文的深入解析,我們可以更好地理解視覺提示注入攻擊的本質,並為未來可能出現的安全挑戰做好準備。隨著AI技術的不斷發展,保持警惕和持續學習將變得越來越重要。

下面連結有完整的圖片以及內容講解。

全能 DMflow.chat:多平台整合、持久記憶與靈活客製欄位,無需額外開發即可連接資料庫與表單。更支援真人與 AI 的無縫切換,網頁互動加 API 輸出,一步到位!

Google Veo 3 影片模型大解禁!Gemini App 全球擴展,但「以假亂真」的隱憂也浮現? Google 最新 AI 影片生成工具 Veo 3 迅速在全球擴展,用戶驚嘆其「神...

Google DeepMind Lyria2 震撼登場:AI 即時譜寫你的音樂狂想曲,高傳真音質顛覆創作想像! Google DeepMind 最新 AI 音樂生成模型 Lyria2 正...

Google Beam橫空出世:2D視訊一秒變3D!跟「尷尬」眼神說掰掰,即時翻譯讓你聊遍全球! 想像一下,開會不用再盯著冷冰冰的螢幕,而是像跟真人面對面一樣自然交流?Google最新發...

Claude AI 網頁搜尋功能「突襲」免費開放!你的 AI 助理即時戰力大升級 Anthropic 旗下 AI 助理 Claude 再次震撼市場!原本僅限付費用戶的網頁搜尋功能,現在全...

Claude 4 橫空出世:Anthropic 最新 AI 模型帶來什麼驚喜?編碼、推理能力再創高峰! Anthropic 正式發表新一代 Claude 模型:Claude Opus 4...

AI界風雲變色!Anthropic 為何拒絕 Windsurf 使用 Claude 4?商戰大戲上演中! Anthropic 最新 AI 模型 Claude Sonnet 4 與 Opu...

Runway 推出 Act-One:突破性 AI 角色動畫生成工具,輕鬆打造專業級動畫表演 文章摘要 Runway 最新發布的 Act-One 工具,只需基本的視頻和語音輸入,即可生成富有表現...

限時七天!Windsurf AI 震撼推出免費無限 GPT-4.1 試用,立即體驗頂尖 AI!(2025-0414-0421) AI 界的朋友們注意!Windsurf AI 宣布提供為期...

Google AI 再進化!Gemini 2.5 橫空出世,輕巧版、思考版同步登場! Google I/O 2025 大會帶來震撼彈!全新 Gemini 2.5 系列 AI 模型亮相,包...

By continuing to use this website, you agree to the use of cookies according to our privacy policy.