在語音 AI 的競賽場上,大家總是習慣盯著 OpenAI 或 Google 的最新動態,期待他們端出下一個震撼世界的產品。但就在最近,一個開源權重模型無聲無息地爬上了排行榜的頂端,讓許多科技巨頭感到汗顏。這款名為 Step-Audio-R1.1 的模型,由 StepFun(階躍星辰)開發,它不僅在語音推理能力上刷新了紀錄,更在即時互動的流暢度上展現了驚人的實力。

如果您以為這只是另一個普通的語音模型,那可就大錯特錯了。它在 Artificial Analysis 的語音推理基準測試(Speech Reasoning benchmark)中,以 96.4% 的準確率拿下了冠軍寶座,直接將 Grok、Gemini 乃至 GPT-Realtime 甩在身後。這究竟是怎麼做到的?讓我們來拆解這項技術背後的秘密。

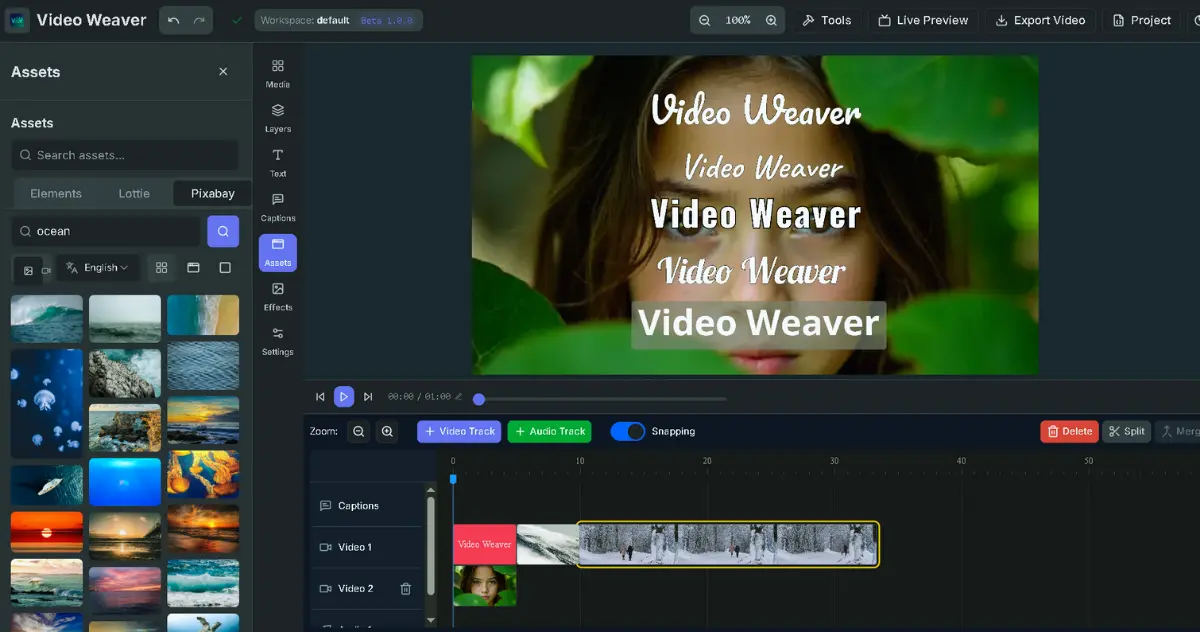

語音推理的新高度:數據不會說謊

讓我們先來看看最直觀的數據表現。根據 Artificial Analysis 的 Big Bench Audio 數據集測試結果,Step-Audio-R1.1 展現了壓倒性的優勢。在這份榜單上,排在第二名的 Grok Voice Agent 成績是 92.3%,而廣受關注的 GPT-4o Realtime Preview 則落在 66% 到 68% 之間。

這意味著什麼?這代表在處理複雜的語音指令、理解語境以及進行邏輯推演時,Step-Audio-R1.1 的表現比目前市面上昂貴的商業模型還要精準。這並非單純的語音轉文字再處理,而是真正的「端到端」(End-to-End)語音原生推理。模型直接聽懂了聲音中的邏輯,而不是依賴文字轉錄的中介。

對於開發者與研究人員來說,這是一個激動人心的消息,尤其是當您可以在 Hugging Face 下載 Step-Audio-R1.1 的權重,親自驗證這項技術時,這種震撼感會更加真實。

速度與智慧的博弈:打破傳統權衡

長期以來,AI 領域存在一個難以忽視的矛盾:想要模型更聰明,通常就得犧牲反應速度;想要反應快,往往就得犧牲推理的深度。但在即時語音對話中,延遲是使用者體驗的殺手。沒人喜歡對著一個還要思考五秒鐘才能回話的 AI 聊天,那種尷尬的沉默會毀掉所有的沉浸感。

Step-Audio-R1.1 透過一種被稱為「思維配速說話」(Mind-Paced Speaking)的技術,巧妙地解決了這個難題。您可以把它想像成一位經驗豐富的演講者,他們不需要停下來長時間思考,而是能夠邊說邊想,組織語言的同時也在進行深層邏輯推演。

這得益於其獨特的雙腦架構(Dual-Brain Architecture):

- 構思大腦(Formulation Brain): 負責高層次的邏輯推理與內容規劃。

- 表達大腦(Articulation Brain): 專注於語音生成的流暢度與自然度。

這種分工合作的機制,讓模型能夠在輸出的同時進行「思維鏈」(Chain-of-Thought)推理。結果就是,它既能保持極低的延遲,又能處理複雜的任務,完全不需要在速度與智慧之間做取捨。想體驗這種流暢感的朋友,可以前往 ModelScope 的 Demo 頁面 試試看。

聽見聲音裡的邏輯:聲學基礎推理

傳統的語音模型經常會遇到一個「倒置縮放」(inverted scaling)的問題。簡單來說,當我們強迫模型過度依賴文字轉錄來進行推理時,它往往會丟失聲音中包含的情緒、語氣以及細微的停頓,這些都是人類溝通中傳遞訊息的重要部分。結果導致推理能力反而下降。

Step-Audio-R1.1 採取了一種名為 Acoustic-Grounded Reasoning 的策略。它不再只是「閱讀」聲音轉成的文字,而是直接「聆聽」聲音本身的聲學特徵。

透過迭代式的自我蒸餾(iterative self-distillation)技術,這款模型學會了如何在聲音數據中直接提取邏輯線索。這讓原本可能成為負擔的「深思熟慮」,轉化為一種優勢。這種技術路徑證明了,未來的語音 AI 必須是原生的,必須懂得聲音的語言,而不僅僅是文字的搬運工。

開源權重的意義:不只是技術展示

除了性能強大,Step-Audio-R1.1 最令人興奮的一點在於它的「開放性」。在大多數頂尖模型都選擇閉源、按 API 調用收費的現狀下,StepFun 選擇公開權重(Open Weight)。

從「語音推理與輸入價格」的對比圖表中可以看出,Step-Audio-R1.1 位於最吸引人的象限:高性能且成本可控(若是自行部署)。這對於想要打造低延遲語音助理、即時翻譯設備或是教育輔助工具的開發者來說,無疑是打了一劑強心針。您不再需要受制於昂貴的 API 費用,就能擁有 SOTA 等級的語音推理能力。

常見問題解答 (FAQ)

為了幫助大家更深入理解這項技術,這裡整理了幾個關鍵問題:

1. 什麼是「雙腦架構」,它如何提升對話流暢度?

「雙腦架構」是 Step-Audio-R1.1 的核心設計理念。它將模型分為兩個部分:一個「構思大腦」負責思考邏輯和策略,另一個「表達大腦」負責將這些想法轉化為流暢的語音。這就像人類在演講時,腦中在構思下一段論點,嘴巴卻能不停頓地說話。這種機制讓模型可以在不犧牲反應速度的前提下,進行複雜的邏輯運算,實現真正的即時互動。

2. 為何 Step-Audio-R1.1 的 96.4% 準確率如此重要?

這個數字來自 Artificial Analysis 的 Big Bench Audio 測試,是目前業界公認衡量語音模型推理能力的標準之一。96.4% 的得分意味著該模型在理解複雜語音指令、處理多步驟任務時的準確度極高,甚至超越了 GPT-4o Realtime 和 Gemini 等商業閉源模型。這代表開源模型在語音領域已經具備了與科技巨頭正面對決,甚至超越對手的實力。

3. Step-Audio-R1.1 與傳統的語音轉文字模型有何不同?

傳統方法通常是「語音轉文字 -> 文字推理 -> 文字轉語音」的三段式流程,這過程中容易丟失語氣、情感等聲學資訊,且延遲較高。Step-Audio-R1.1 採用「端到端」(End-to-End)的原生語音推理,直接在聲學特徵上進行運算。這不僅保留了豐富的語音細節,還避免了轉錄過程中的錯誤,讓 AI 聽起來更聰明、反應更靈敏。

4. 我可以在哪裡試用或下載這個模型?

Step-Audio-R1.1 是一個開源權重模型。開發者可以前往 Hugging Face 模型頁面 下載權重進行部署。如果您只是想單純體驗它的對話能力,也可以訪問 ModelScope 的線上 Demo 進行互動測試。