DMflow.chat

广告

DMflow.chat:智慧整合,创新沟通!除了持久记忆与定制字段外,更支持真人与 AI 的灵活切换,无缝连接数据库与表单,让网页互动更灵活高效。

AI 竞赛日益激烈,成为科技巨头之间的追逐游戏。GPT-4o 在 Google I/O 之前推出,其多模态(或称全模态)功能惊人,对生成 AI 竞赛产生了重大影响。然而,Google 也不甘示弱。在 Google I/O 期间,他们宣布了新款的 Gemini 和 Gemma 模型。其中,Gemini 1.5 Flash 脱颖而出,成为最具影响力的模型。在本文中,我们将探讨 Gemini 1.5 Flash 的顶级功能,并与 Gemini 1.5 Pro 进行比较,以确定哪个更佳。

根据 Google 公布的基准分数,Gemini 1.5 Flash 在音频性能上优于 Google 的所有其他大型语言模型(LLM),并且在其他基准上与即将推出的 Gemini 1.5 Pro(2024 年 2 月)模型相当。尽管我们不建议完全依赖基准来评估任何 LLM 的性能,但它们有助于量化性能差异和小幅升级。

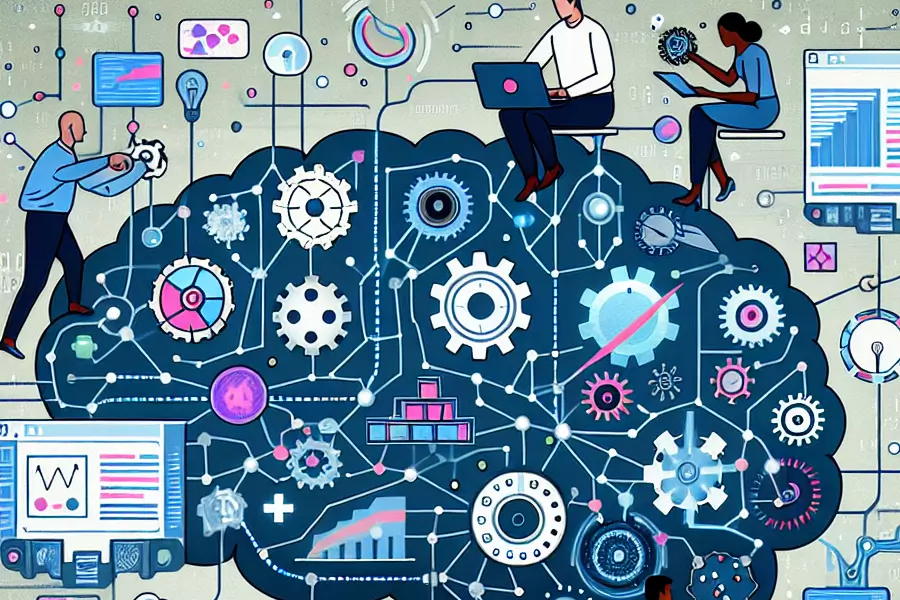

一个不容忽视的问题是 Gemini 1.5 Flash 的成本。相比 GPT-4o,Gemini 1.5 Flash 更加实惠。

| 输入 | 输出 | |

|---|---|---|

| $0.35 / 100 万 tokens(128k down) $0.70 / 100 万 tokens(128k up) |

$1.05 / 100 万 tokens(128k down) $2.10 / 100 万 tokens(128k up) |

| 输入 | 输出 | |

|---|---|---|

| $5.00 / 百万 tokens | $15.00 / 百万 tokens |

与 Gemini 1.5 Pro 一样,Flash 具有 100 万个 token 的上下文窗口,这比任何 OpenAI 模型都大,是生产级 LLM 中最大的上下文窗口之一。更大的上下文窗口允许更多的数据理解,并可以通过增加块大小来改进第三方技术(如 RAG,检索增强生成)在大型知识库中的应用。此外,更大的上下文窗口允许生成更多文本,这在撰写文章、电子邮件和新闻稿等场景中非常有用。

Gemini 1.5 Flash 是多模态的。多模态允许以音频、视频、文档等形式输入上下文。具有多模态的 LLM 更加多才多艺,打开了生成 AI 应用的更多大门,而无需任何预处理。

Gemini 1.5 模型可以处理非常长的上下文,这种规模在当代大型语言模型(LLM)中是前所未有的,使其能够处理包括整个文档集、数小时视频和近五天音频的长篇混合模态输入。

多模态功能还允许我们将 LLM 作为其他专业服务的替代品。例如,OCR 或网页抓取。

顾名思义,Gemini 1.5 Flash 在响应时间方面设计具有优势。例如,上述网页抓取示例中,响应时间约为 2.5 秒,几乎快 40%,使得 Gemini 1.5 Flash 成为自动

DMflow.chat:智慧整合,创新沟通!除了持久记忆与定制字段外,更支持真人与 AI 的灵活切换,无缝连接数据库与表单,让网页互动更灵活高效。

Gemini的重大升级:1.5 Flash带来更快响应、扩展访问等功能 Google宣布Gemini人工智能助手的重大更新,包括在40多种语言和230多个国家和地区推出1.5 Flash版本,...

提示工程:优化大型语言模型输出的策略与技巧 本指南分享了如何从大型语言模型(如 GPT-4)中获得更好结果的策略和技巧。这些方法可以单独使用,也可以组合使用以达到更好的效果。 六大策略获得...

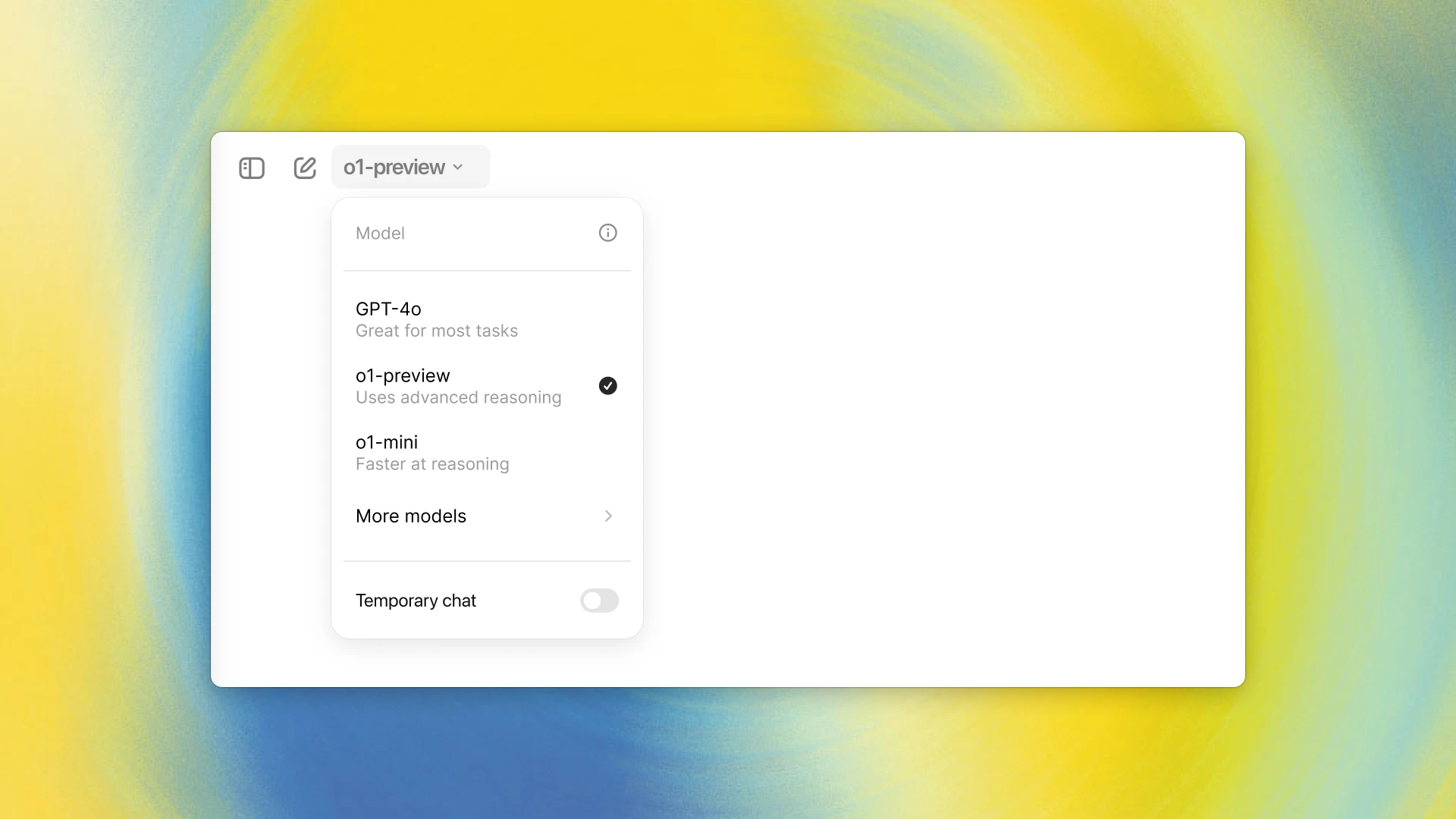

OpenAI o1 模型:解决复杂问题的全新思考型 AI 突破性的 AI 推理能力,为科学、编程和数学领域带来革命性进展 OpenAI 最近推出了一系列全新的 AI 模型,旨在解决复杂问题并...

SearchGPT 原型:AI 搜寻的新时代 OpenAI 正在测试 SearchGPT,这是一个结合 AI 模型和网络信息的新搜寻功能原型。它旨在提供快速、及时的答案,并清晰地列出相关来源。...

By continuing to use this website, you agree to the use of cookies according to our privacy policy.